torch7のバリエーションcl-torchはおススメできません [人工知能(ディープラーニング)]

torch7のバリエーションには、open-clで処理をGPUに割り当てるものもあります。

cl-torchとか、distro-clとか呼ばれているものですが…オススメできません。

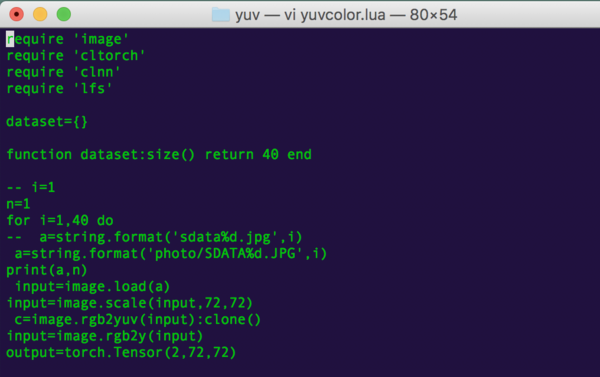

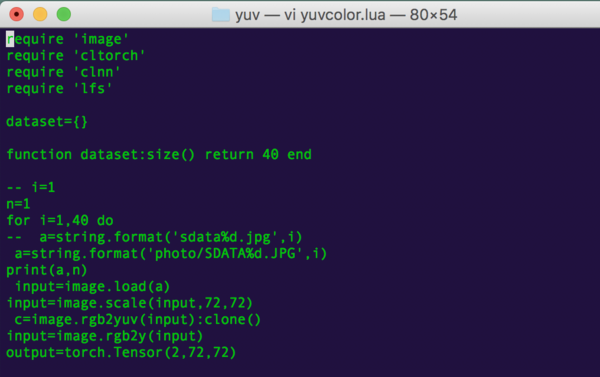

(プログラムのライブラリにclnnやcltorchが含まれているcl-torch動作版のプログラム)

導入してみたのですが…すごく遅いのです。

MacBook Pro (15インチ, 2016)、GPUにRadeon Pro 460を搭載しているモデルでも、下手にOpen-CLなど使わずにCPUで処理した方が早かったほどです。

最初はCPUのパワーを使わずに動いていて、「お、これはいけるか?」と喜んだのですが…

JETSON TK1の5倍もの時間がかかります。(JETSON TK1(CUDA動作)で40秒で終わる処理が、cl-Torchでは200秒以上かかります)

まさかと思って、CPUで動作させると、同じ処理に40秒…しかかかりませんでした。

しかも、別のLINUXのTorch7で作成した人工知能データを読み込ませると、エラーで動作しないというおまけつきです。

発想は良かったのですが…中身が付いてきてませんでした。

CUDAが使えないパソコンの救世主に見えて、実は見掛け倒しという悲しい運命を背負ってしまったようです。

さっそく、cl-Torchは、コマンドラインからさっくり「rm -rf cl-torch」で削除して、通常版のtorch7をインストールしました。

それにしても、2016年のMACBOOK PROはCPU動作でもJETSON TK1のCUDA動作に負けない性能になっていたんですね。

2012年モデルのMAC MINIはTK1にかなり大差で負けてしまうのですが。

(3万円のJETSON TK1が大健闘していると言えるかもしれません)

結論としては、cl-torchはお勧めできません。

なにせ、正式なtorch7で作成した人工知能モデルがエラーで動かないのは致命的です。

cl-torchとか、distro-clとか呼ばれているものですが…オススメできません。

(プログラムのライブラリにclnnやcltorchが含まれているcl-torch動作版のプログラム)

導入してみたのですが…すごく遅いのです。

MacBook Pro (15インチ, 2016)、GPUにRadeon Pro 460を搭載しているモデルでも、下手にOpen-CLなど使わずにCPUで処理した方が早かったほどです。

最初はCPUのパワーを使わずに動いていて、「お、これはいけるか?」と喜んだのですが…

JETSON TK1の5倍もの時間がかかります。(JETSON TK1(CUDA動作)で40秒で終わる処理が、cl-Torchでは200秒以上かかります)

まさかと思って、CPUで動作させると、同じ処理に40秒…しかかかりませんでした。

しかも、別のLINUXのTorch7で作成した人工知能データを読み込ませると、エラーで動作しないというおまけつきです。

発想は良かったのですが…中身が付いてきてませんでした。

CUDAが使えないパソコンの救世主に見えて、実は見掛け倒しという悲しい運命を背負ってしまったようです。

さっそく、cl-Torchは、コマンドラインからさっくり「rm -rf cl-torch」で削除して、通常版のtorch7をインストールしました。

それにしても、2016年のMACBOOK PROはCPU動作でもJETSON TK1のCUDA動作に負けない性能になっていたんですね。

2012年モデルのMAC MINIはTK1にかなり大差で負けてしまうのですが。

(3万円のJETSON TK1が大健闘していると言えるかもしれません)

結論としては、cl-torchはお勧めできません。

なにせ、正式なtorch7で作成した人工知能モデルがエラーで動かないのは致命的です。

コメント 0